TIA ขยับ!! เตรียมอัพเดทมาตรฐาน Data Center

20 มีนาคม 2569

TIA ขยับ!! เตรียมอัพเดทมาตรฐาน Data Center

เมื่อต้นปี 2026 วงการมาตรฐาน Data Center ขยับครั้งใหญ่ โดยสมาคมอุตสาหกรรมโทรคมนาคม (TIA) ได้เริ่มกระบวนการอย่างเป็นทางการในการออก Addendum ต่อมาตรฐาน Data Center ANSI/TIA-942-C โดยมุ่งเน้นเรื่อง AI Computing โดยทาง TIA ได้ประกาศเชิญชวนผู้เกี่ยวข้องที่เป็นสมาชิกของ TIA (Call for interest) มาเข้าร่วมโครงการนี้อย่างเป็นทางการเมื่อวันที่ 26 กุมภาพันธ์ที่ผ่านมา โดยระบุชื่อเบื้องต้น ของ addendum TIA-942-C-1 คือ "Telecommunications Infrastructure Standard for Data Centers – Addendum 1: Artificial Intelligence"

แล้วทำไมถึงต้องออก Addendum ใหม่? ทั้งๆที่ TIA-942-C ก็เพิ่งออกมาเมื่อ พฤษภาคม 2024 นี้เอง

คำตอบสั้นๆ คือ : AI มันเปลี่ยนเกมไปเร็วมากจนมาตรฐานตามแทบไม่ทัน

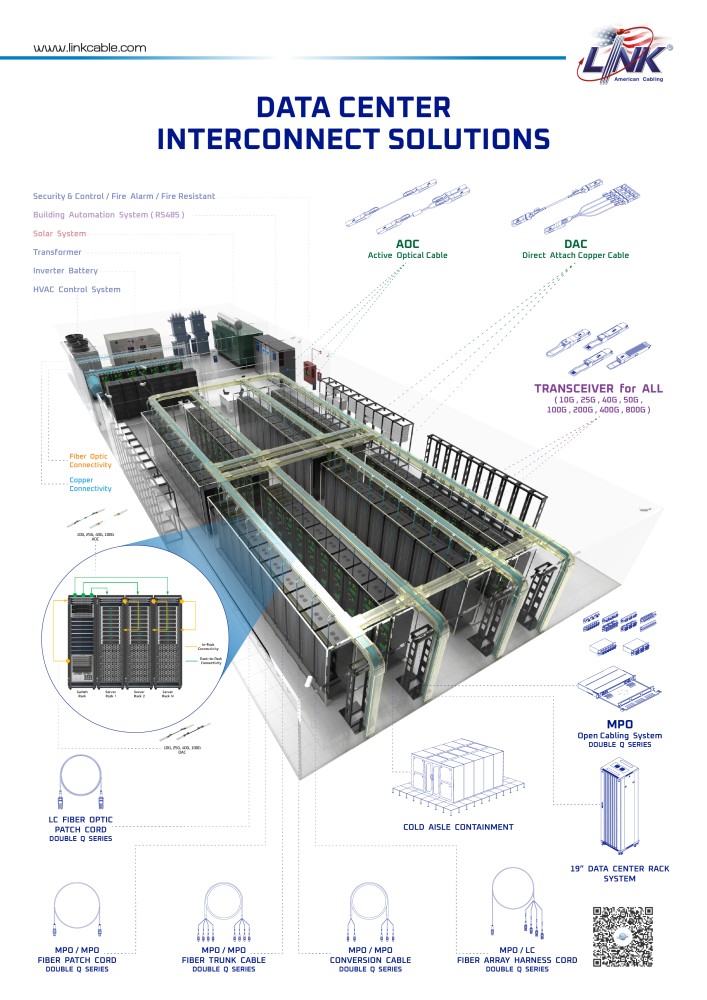

AI Data Center มี workload ที่มาก และการบริหารจัดการสายภายใน Data Hall อาจต้องเจอกับสายไฟเบอร์ มากถึง 10 เท่าเมื่อเทียบกับ Data Center แบบดั้งเดิม

Jonathan Jew หนึ่งในสมาชิกคนสำคัญของคณะ

TR42.1 ซึ่งเป็นคณะร่างมาตรฐาน ANSI/TIA-942-C

เคยกล่าวไว้ในปี 2024 ว่า 400G จะเป็นความเร็วพื้นฐานเริ่มต้นสำหรับ AI Data Center และในปี 2026 เราจะเห็น 1.6 Terabit ซึ่งต้องใช้ไฟเบอร์ถึง

16 core

เขาเคยออกแบบโปรเจกต์ AI Data Center ขนาดใหญ่ที่ต้องเชื่อมต่อ

AI cluster 2 ชุด จาก 2 ห้องเข้าด้วยกัน ต้องใช้ไฟเบอร์ราว

70,000–80,000 core ซึ่งถือว่าเป็นปริมาณมหาศาลเกินกว่าที่จะนึกถึง

และนั่นจึงทำให้เกิดเทคโนโลยีของหัวไฟเบอร์แบบ Array ชนิดต่างๆมากขึ้น

ไม่ใช่เพียงแค่หัว MPO หรือ MTP อย่างที่เราคุ้นชินกัน

เช่น หัว VSFF, MMC, MDC รวมไปถึงสายสำเร็จรูปพร้อม

Transceiver เช่น DAC และ AOC ก็นิยมต่อการใช้งานมากขึ้นเรื่อยๆ

TIA-942-C-1 จะครอบคลุมอะไรบ้าง?

TIA-942-C-1 จะครอบคลุม ทั้งระบบระบายความร้อน (cooling) ระบบไฟฟ้า (electrical) รวมถึงรายละเอียดด้านสายสัญญาณ นั่นหมายความว่า Addendum นี้ไม่ได้แค่บอกว่า "ควรใช้สายแบบไหน" แต่มองภาพรวมของโครงสร้างพื้นฐานทั้งหมดที่ต้องรองรับ AI workload ที่กินพลังงานสูงและต้องการ bandwidth สูงพร้อมกัน แม้การอัพเดทมาตรฐานนี้จะยังอยู่ในระหว่างร่าง แต่ทิศทางที่ชัดเจนจากข้อมูลในตลาดบอกเราว่า สำหรับการออกแบบ Data Center ในปี 2026 ควรวางโครงสร้างให้ยืดหยุ่นเพียงพอ ทั้งในด้าน space, power distribution, cabling pathways, และ cooling เพื่อรองรับเทคโนโลยีที่จะก้าวกระโดดและพัฒนาต่อเนื่อง โดยเฉพาะสำหรับ AI cluster และพื้นที่ระดับ Extreme high-density

สุดท้ายสำหรับประเทศไทยบ้านเราก็เริ่มมีการลงทุนระดับ Hyper Scale Data Center เข้ามาเรื่อยๆ

รวมถึง Data Center ทั่วไปตามองค์กรก็เริ่มขยายตัวมากขึ้น การใช้

MPO fiber แบบ high-density เช่น 144-fiber

trunk cable สามารถลดจำนวนสายสัญญาณที่ต้องจัดการได้ถึง 90% เมื่อเทียบกับการเดินสายแบบ One cable per core และที่สำคัญที่สุด

ในสภาพแวดล้อมที่ rack ปล่อยความร้อนระดับ 10–20 kW

การจัดการสายที่ดีสามารถลดต้นทุนระบบ cooling ได้ถึง 20–30%

และในทางกลับกัน

ปริมาณสายที่เยอะขึ้น และการจัดสายอย่างไม่เป็นเป็นระเบียบ จะกลายเป็นเรื่องวิกฤตสำหรับ

Data Center

Author : Thuwanon Singkajorn – Product Specialist Manager